Sau khi phát hành các mô hình AI tổng quát có thể xử lý nội dung văn bản, âm thanh và dịch thuật, Meta hiện đã chuyển sự chú ý sang mã (code). Công ty đã giới thiệu Code Llama, một phiên bản của mô hình ngôn ngữ lớn được thiết kế riêng cho mã hóa. Về cốt lõi, mô hình này nhận các lời nhắc bằng văn bản và biến chúng thành mã giống như cách ChatGPT và DALL-E2 sẽ phản hồi nếu được yêu cầu viết một vài đoạn văn hoặc tạo một hình ảnh tương ứng.

Meta không phải là công ty đầu tiên đưa trí tuệ nhân tạo thông minh vào thế giới mã hóa. Ví dụ: Microsoft gần đây đã tích hợp các khả năng của GPT-4 vào hệ thống GitHub Copilot để hỗ trợ các nhà phát triển. Vào tháng 4 năm 2023, Google cũng đã phát triển các khả năng lý luận và toán học nâng cao cho Bard AI của mình, cho phép nó hỗ trợ các tác vụ lập trình như tạo mã. Với Code Llama, Meta muốn cho phép người dùng tạo mã gốc và cũng nhận được trợ giúp sửa mã hiện có của họ.

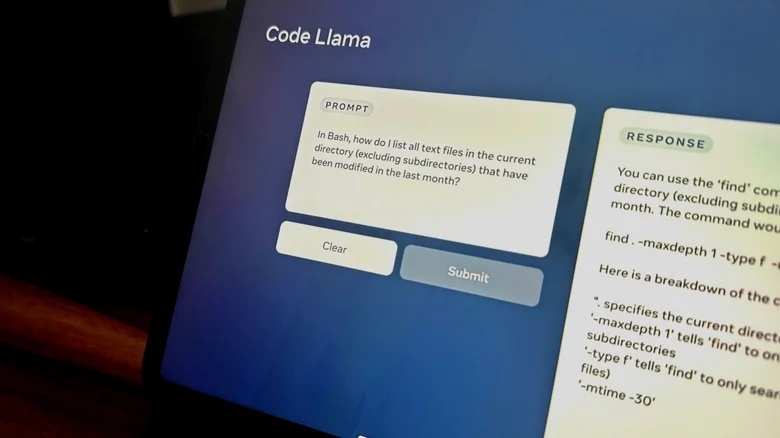

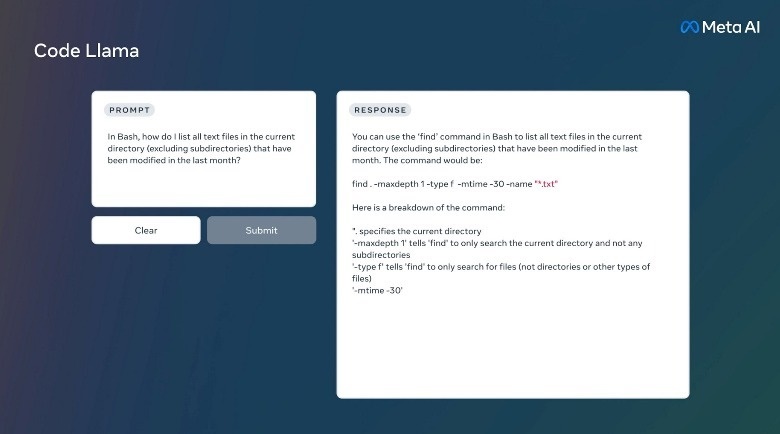

Meta cho biết: "Nó có khả năng giúp quy trình làm việc nhanh hơn và hiệu quả hơn cho các nhà phát triển, đồng thời hạ thấp rào cản gia nhập đối với những người đang học viết mã". Điều thú vị là lời nhắc do người dùng đưa ra có thể bằng ngôn ngữ tự nhiên hoặc đoạn mã. Tùy thuộc vào bản chất của lời nhắc, Code LLama có thể tạo mã mới, hoạt động như một loại công cụ tự động hoàn thành nào đó (như GitHub Copilot) và giúp giải quyết các lỗi. Hiện tại, Code Llama hỗ trợ một số ngôn ngữ lập trình phổ biến nhất, bao gồm C++, Python, Javascript và PHP.

Các mô hình khác nhau cho các nhu cầu khác nhau

Công ty tuyên bố rằng Code Llama đã đi trước các đối thủ của mình trong các tiêu chuẩn mã hóa phổ biến như HumanEval. Meta đang phát hành Code Llama với ba kích cỡ khác nhau: 7 tỷ tham số, 13 tỷ tham số và 34 tỷ tham số. Model cấp thấp hơn sẽ hữu ích cho các tác vụ đơn giản hơn, trong khi model cao cấp hơn có nhu cầu phần cứng đòi hỏi khắt khe hơn nhưng cũng có khả năng cao hơn.

Ví dụ, tầng cơ bản 7B có thể chạy trên một máy tính với một GPU duy nhất; nó phù hợp cho các tác vụ có thời gian trễ thấp như hoàn thành mã. Mẫu 13B cung cấp khả năng điền vào giữa (FIM) mạnh mẽ hơn một chút, trong khi biến thể 34B dành cho các chuyên gia tìm kiếm sự hỗ trợ mã nâng cao với việc tạo mã phức tạp, chèn khối mã và gỡ lỗi — miễn là họ có phần cứng để xử lý công việc đó.

Hơn nữa, Meta đã tạo ra hai biến thể khác của Code Llama dựa trên môi trường lập trình. Code Llama Python dành cho Python, một trong những ngôn ngữ lập trình hiệu quả và phổ biến nhất cho các tác vụ trí tuệ nhân tạo và học máy. Phiên bản khác là Code Llama — Instruct, phù hợp hơn cho các yêu cầu bằng ngôn ngữ tự nhiên và dành cho những người không chuyên muốn tạo mã. Tất nhiên, nó không hoàn hảo, tuy nhiên Meta tuyên bố rằng nó cung cấp các phản hồi an toàn hơn so với các đối thủ. Meta đã phát hành Code Llama trên GitHub cùng với một bài báo nghiên cứu cung cấp thông tin chi tiết hơn về công cụ AI tạo mã cụ thể.